Start in die Photogrammetrie

von Charlotte Toma, WhereGroup

Infobrief 01 | 2019

Tagtäglich generieren wir im Alltag - ob privat oder beruflich - eine Vielzahl an Bildern und Videos. Damit erzeugen wir eine immense Menge an Daten, die wir für diverse Zwecke nutzen können. Manche Bilder werden bereits vom Aufnahmegerät im Sinne der Photogrammetrie als Panoramabild bereitgestellt. Mit nur wenigen Schritten kann man jedoch ein solches Bild oder aber auch komplexere Modelle selbst erstellen.

Die Verwendung von Unmanned Aerial Vehicles (UAVs) - gemeinhin Drohnen genannt - als Fernerkundungswerkzeug, bietet allen Anwendern im Geoinformations-Bereich darüber hinaus ungeahnte Möglichkeiten für die Aufnahme von hochaktuellen und genauen Informationen.

Aktuelle Erkenntnisse im Bereich der Photogrammetrie erlauben auch Einsteigern eine Bildauswertung und Weiterverarbeitung der Bilddaten im großen und kleinen Maßstab.

Wofür kann ich Photogrammetrie einsetzen?

Es gibt eine Vielzahl an Möglichkeiten und Anwendungsfällen – da die Methoden skalierbar sind können UAV-Bilddaten eigentlich in jedem Themengebiet in Wert gesetzt werden. Einige Beispiele sind z. B.:

- Erfassung des Schädlingsbefalls bei Nutzpflanzen

- Bestandsaufnahme von Bäumen

- Aufnahme der zeitlichen Veränderung von natürlichen und anthropogenen Phänomenen, z.B. Küstenbewegung oder Bebauung eines Grundstücks

- aktuelle Volumenberechnung im Steinbruch

- semi-automatische Erfassung und Klassifizierung von Gebieten, wie z. B. Friedhofsanlagen oder Campingplätzen

- Modellierung von 3D-Ansichten für den allgemeinen Gebrauch und das Geomarketing, z. B. Sehenswürdigkeiten im Stadtplan oder Kanalabschnitte für das Kanalkataster/ Kanalhöhenschein

Wie kann ich meine Bilder nutzen?

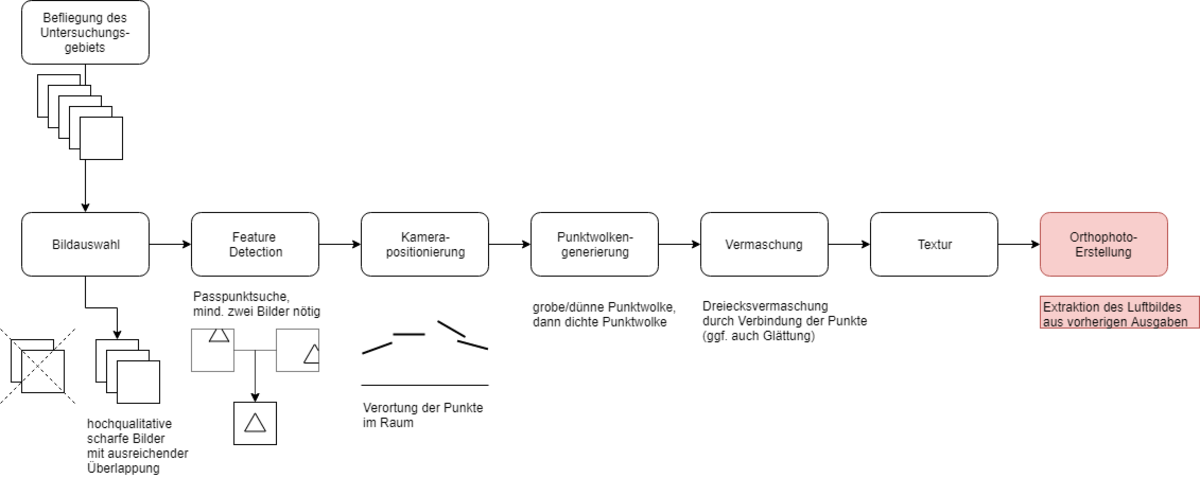

Bei dem Einstieg in die Photogrammetrie ist zunächst unklar, wie aus den einzelnen Bildern ein genaues 3D-Modell und Luftbild generiert werden kann. Jeder hat bereits einmal seine Panoramafunktion im Handy genutzt und mehr oder weniger gute Ergebnisse erzielt. Doch wie können wir diesen Mechanismus auf größerer Skala für einen geographischen Anwendungsfall für uns nutzen?

1. Bildauswahl

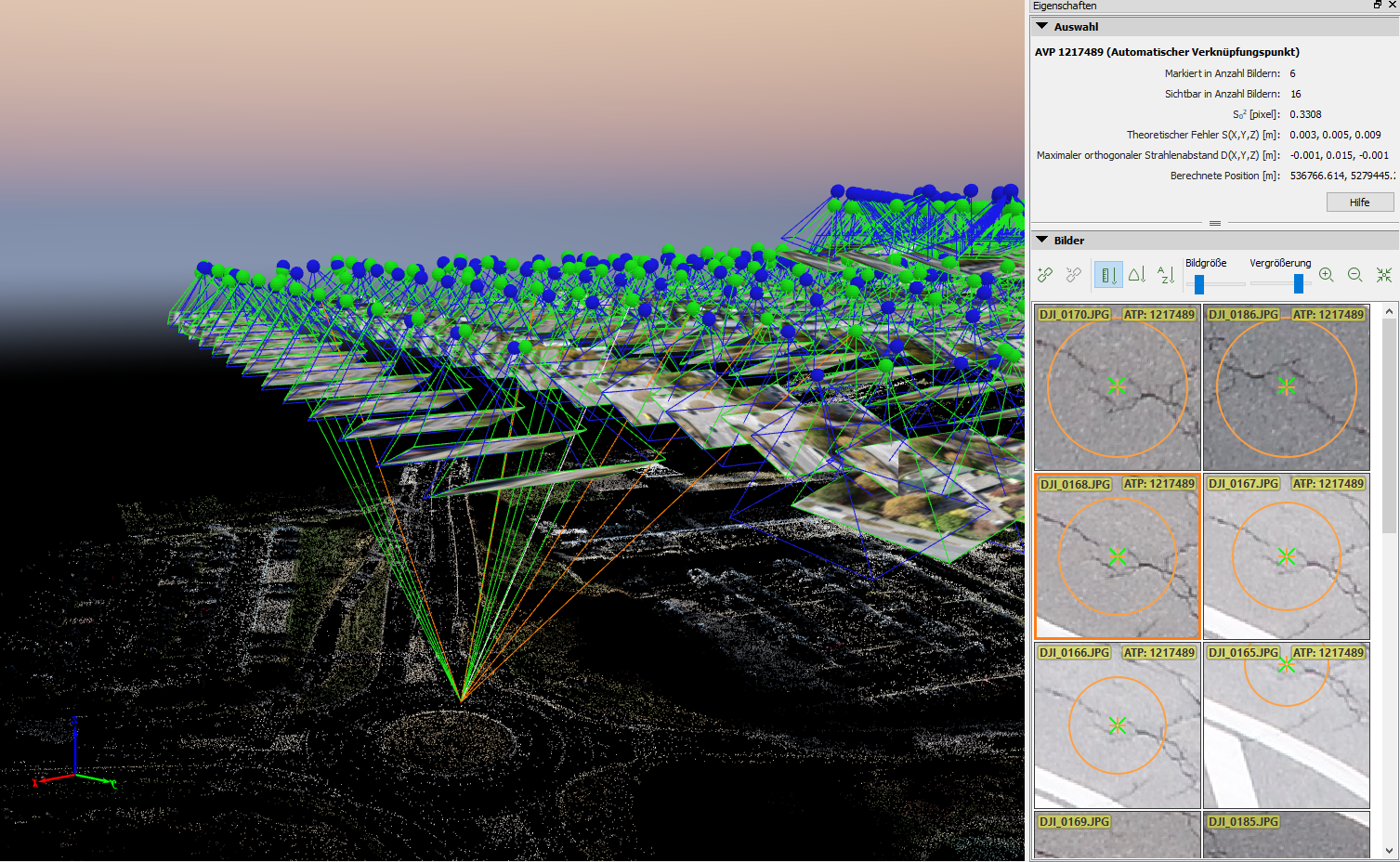

Abbildung 1 zeigt zwei nacheinander in einem Befliegungsintervall erfasste Aufnahmen. Der markierte Kreis dient der späteren Referenzpunkt-Erfassung.

Bei der Bildverarbeitung muss selbstverständlich die Limitation in Bezug auf die Aufnahmequalität beachtet werden. Vor allem bei bewegten Objekten (Menschen, Autos, Baumspitzen), Reflektionen (Solaranlagen, Wasser), einfarbigen Oberflächen oder bei detaillierten Objekten (Blätter, Äste, Gerüste) ist die Verarbeitung der Bilder derzeit häufig noch mit Schwierigkeiten verbunden.

2. Referenzpunkt-Auswahl

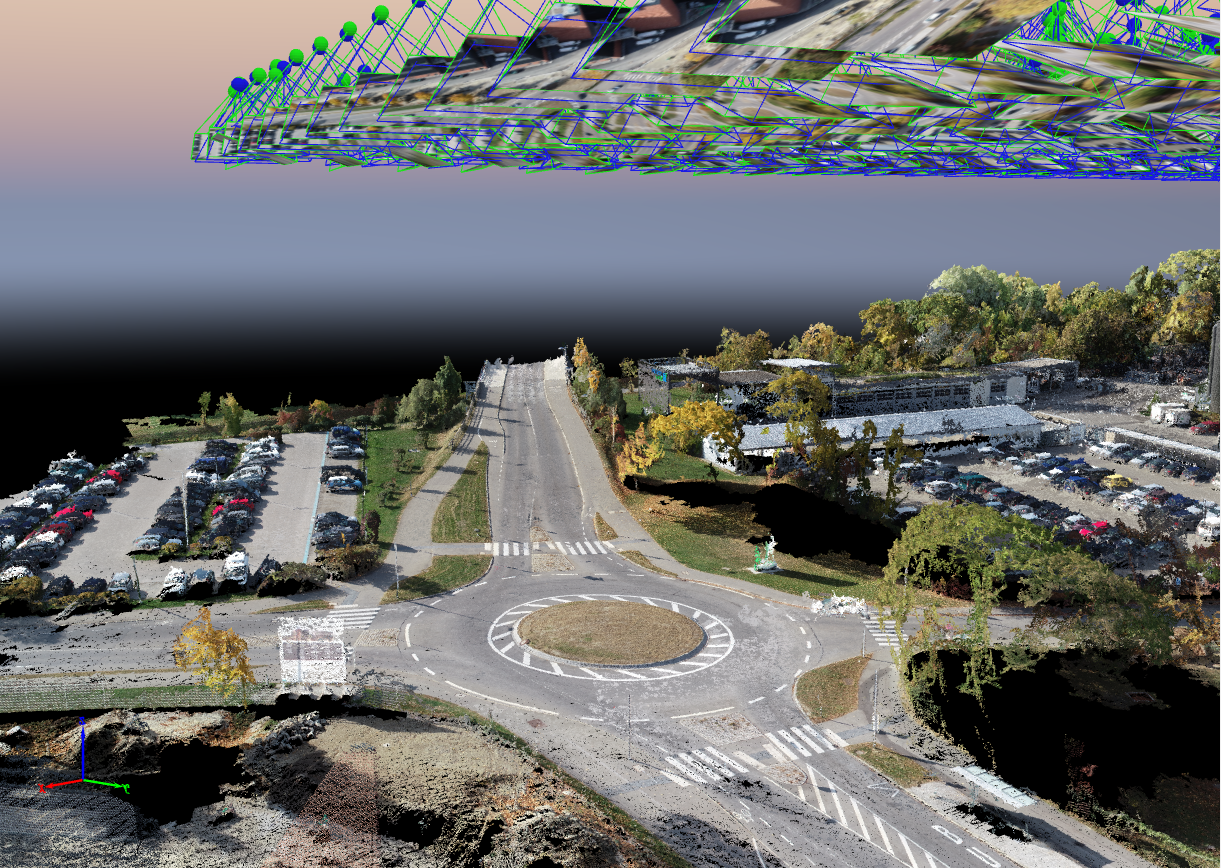

3. Punktwolken-Generierung

Die Dichte dieser Punktwolke hängt von der Menge an Passpunkten ab, die in dem ersten Schritt gefunden wurden. Um später ein durchgehendes sauberes Modell ohne Ausreißer oder Löcher zu generieren, müssen weitere Punkte ermittelt werden.

Je nach genutzter Software und Anwendungsfall kann nun das Untersuchungsgebiet weiter eingeschränkt oder Ausreißer manuell entfernt werden, um die weiteren Berechnungen zu optimieren.

4. Vermaschung und Texturierung

Daher wird als nächster Schritt eine Dreiecksvermaschung durch die Verbindung der Punkte durchgeführt. Somit wird aus der feinen Punktwolke ein Oberflächenmodell. Optional bietet sich hier eine Glättung der Oberfläche oder Füllen von Löchern an (vergl. auch Abb. 5).

Da wir neben der eigentlichen Oberfläche jedoch auch Objekte zuweisen und visuell ansprechende Ergebnisse liefern möchten, wird nun dieser Mesh mit einer Textur ausgestattet. Je nach Auflösung der eigentlichen Aufnahmen und Menge an Referenzpunkten auf dem Modell zeigt diese mehr oder weniger Details (Löcher in Baumkronen, Schatten und Spiegelungen).

5. Orthophoto-Extraktion

Aus der Punktwolke oder aus dem Mesh mit/ohne Textur heraus kann nun ein Orthophoto generiert werden.

Je nach Anwendungsfall und Software können sowohl Geländemodelle, als auch Oberflächenmodelle extrahiert und in bestehende Geodateninfrastrukturen eingebunden werden. Einige Systeme bieten zudem weitere Funktionen, wie z. B. Höhenliniengenerierung oder Volumenberechnung.

Die erzeugten Modelle und Bilder können als weiterer Schritt dann in einem GIS bearbeitet werden (z.B. Falschfarbenanalyse) oder in eine bestehende GDI (z.B. WMS) integriert werden.

Womit fange ich an?

Dank stetiger Weiterentwicklungen im Open-Source-Bereich gibt es bereits einige frei verfügbare Hardware- und Softwaresysteme, die ohne größere Investition für die Verarbeitung von eigenen Daten genutzt werden können. Einen guten Einstieg bieten beispielsweise die beiden Open-Source-Systeme OpenDroneMap und VisualSfM.

In Zusammenarbeit mit der WhereGroup werden derzeit für eine Masterarbeit diverse Studien zu den Vor- und Nachteilen von verschiedenen Open-Source und proprietären Photogrammetrie-Softwareprogrammen durchgeführt.

Weitere Informationen zum Thema

Unser Kollege Robert Klemm hält auf der FOSSGIS zu diesem Thema den Vortrag „Drohnenbilder im WebGIS - Wie kommen Drohnen-Bilddaten mithilfe von OpenDroneMap ins WebGIS?“.

Gerne steht Ihnen auch Charlotte Toma, die die Masterarbeit zum Thema schreibt, für weitere Informationen zur Verfügung.

Abb. 5: Schematischer Arbeitsablauf von Photogrammetrie-Bildverarbeitung (Charlotte Toma, WhereGroup)

Abbildungen im Text:

Abb. 1: Bilder vom Verkehrskreisel erfasst mit Mikro-UAV DJI Phantom 4 (Charlotte Toma, WhereGroup)

Abb. 2: Automatisierte Referenzpunkt-Auswahl in Pix4D (Charlotte Toma, WhereGroup)

Abb. 3: Dichte Punktwolke mit kleiner Punktgröße in Pix4D (Charlotte Toma, WhereGroup)

Abb. 4: Dreiecksvermaschung mit Textur (Charlotte Toma, WhereGroup)

Weiterführende Links:

OpenDroneMap: https://www.opendronemap.org/

VisualSFM: http://ccwu.me/vsfm/

>>> Zurück zum Inhaltsverzeichnis Infobrief 01 | 2019